Que puede hacer un agente de IA fuera del codigo

Los agentes de IA van mucho mas alla del codigo. Casos reales en salud, legal, restaurants y mas. Como las empresas ya los usan para automatizar tareas del mundo real.

Miguel Fernandez

Resumen completo del keynote de Jensen Huang en NVIDIA GTC 2026: Vera Rubin, Groq 3 LPU, NemoClaw para agentes de IA, DLSS 5, alianzas con IBM y Google, y por qué Jensen proyecta $1 billón en pedidos para 2027.

Jesús Blanco

Autor

Hoy 16 de marzo de 2026, Jensen Huang tomó el escenario del SAP Center en San José, California, ante 30,000 asistentes de 190 países para dar el keynote del NVIDIA GTC 2026. El evento, apodado el "Woodstock de la IA", duró más de dos horas y cubrió chips, software, agentes, robótica, gráficos y hasta un robot de Olaf de Frozen en el escenario.

Este es el resumen de todo lo importante, con el contexto que importa para developers y empresas en Latinoamérica.

Antes de entrar a los productos, el dato que define el estado actual de NVIDIA: Jensen Huang proyecta que los pedidos combinados de Blackwell y Vera Rubin alcanzarán $1 billón de dólares para 2027, el doble del estimado de $500 mil millones que la compañía había dado el año pasado.

Ese número no es marketing. Es la señal de que la demanda de infraestructura de IA sigue acelerando, no desacelerando, a pesar de todas las conversaciones sobre una posible burbuja.

Vera Rubin es la arquitectura sucesora de Blackwell y el sistema que NVIDIA está enviando a clientes este año. Incluye la nueva CPU Vera, diseñada específicamente para ofrecer rendimiento de un solo hilo en tareas de IA, complementando las GPUs en el procesamiento de inferencia a gran escala.

El sistema Grace Blackwell NVL72 fue presentado como el motor definitivo para inferencia masiva hoy, mientras Vera Rubin llega al mercado en los próximos meses.

La sorpresa del keynote fue Kyber, el prototipo de la siguiente arquitectura después de Rubin. Kyber integra 144 GPUs en bandejas de cómputo verticales en lugar de horizontales para aumentar la densidad y reducir la latencia, y llegará como Vera Rubin Ultra en 2027. Y mirando más lejos, Feynman sigue en el calendario para 2028.

Para developers: estos chips definen el costo y la velocidad de inferencia de los modelos que usas a diario. Cada generación reduce el costo por token y aumenta la velocidad de respuesta de APIs como Claude, GPT y Gemini.

Este fue uno de los anuncios más concretos del keynote. NVIDIA presentó el Groq 3 LPU, el primer chip resultado de la adquisición de activos de Groq por $20 mil millones en diciembre pasado, con envíos esperados para el tercer trimestre de 2026.

El Groq 3 LPX rack alojará 256 LPUs y está diseñado para trabajar junto al sistema rack-scale Vera Rubin, con un núcleo optimizado para acelerar las GPUs.

El contexto importante: Groq era conocido por su velocidad de inferencia extrema, generando más de 300 tokens por segundo en modelos grandes. Esa tecnología ahora es parte de NVIDIA. Para quienes usamos Groq como proveedor de API gratuito para agentes como Nanobot, como documentamos en nuestro artículo de nanobot con Coolify y GLM, esto significa que la velocidad que Groq ofrecía va a escalar a la infraestructura completa de NVIDIA.

Este fue el anuncio de software más relevante para developers. NVIDIA lanzó NemoClaw, una plataforma open source para desarrollar y desplegar agentes de IA autónomos de larga duración directamente en el escritorio y dentro de la empresa, usando los sistemas DGX Spark y DGX Station.

NemoClaw permite construir agentes que no solo generan texto sino que escriben código, llaman herramientas, analizan datos, simulan resultados y mejoran continuamente. El stack es open source, lo que significa que puedes inspeccionarlo, modificarlo y desplegarlo en tu propia infraestructura.

Además, Jensen dedicó tiempo a hablar sobre OpenClaw, el proyecto del desarrollador austríaco Peter Steinberger que explotó en popularidad en enero. Steinberger se unió a OpenAI el mes pasado y Altman confirmó que OpenClaw continuará como proyecto open source bajo una fundación con el apoyo de OpenAI. NVIDIA anunció integración nativa con OpenClaw dentro de su ecosistema.

Nemotron 3 Super completa el panorama de agentes: un modelo diseñado específicamente para coordinar múltiples sub-agentes trabajando en paralelo en tareas complejas, con un rendimiento 5 veces superior a su generación anterior.

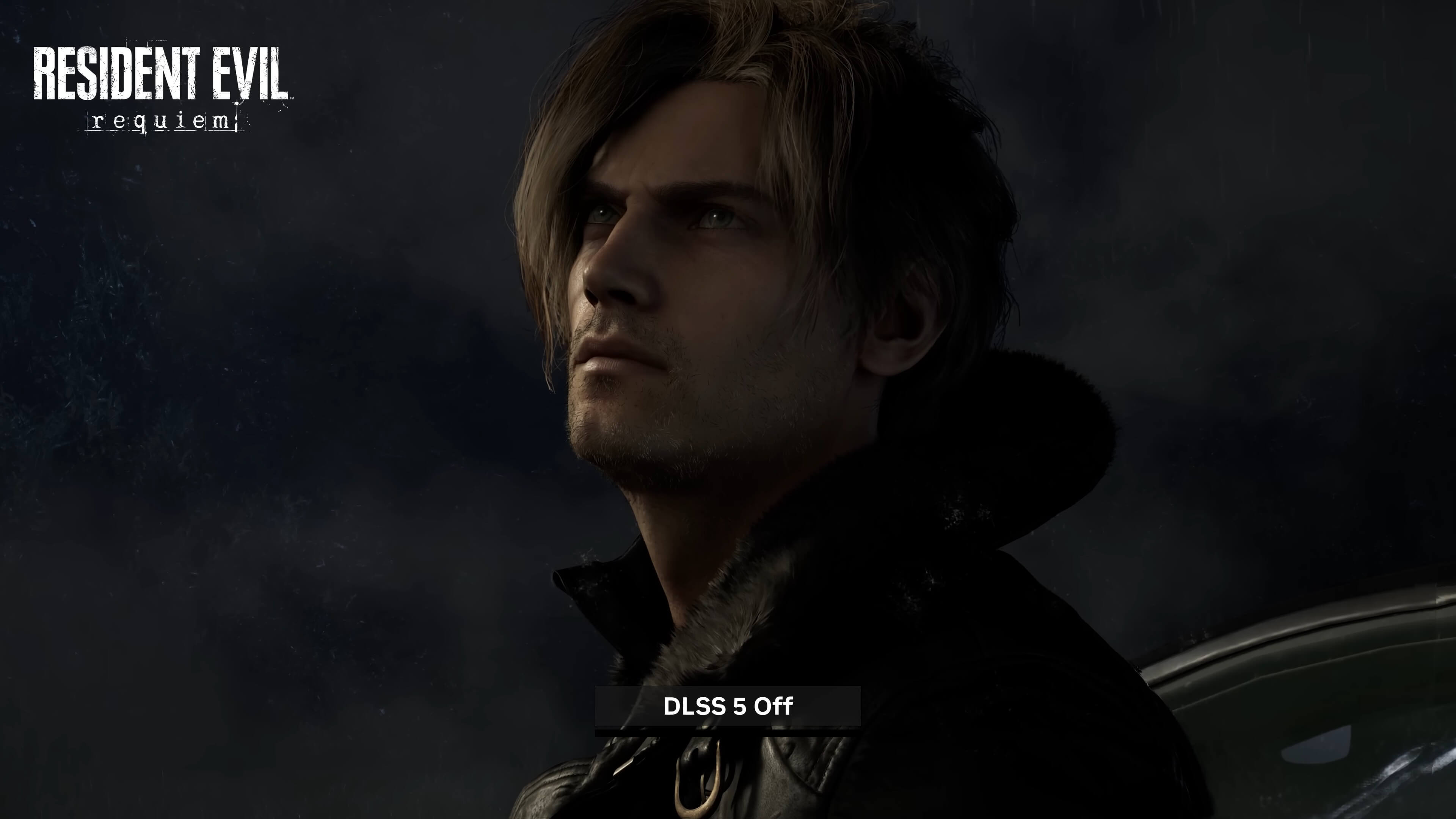

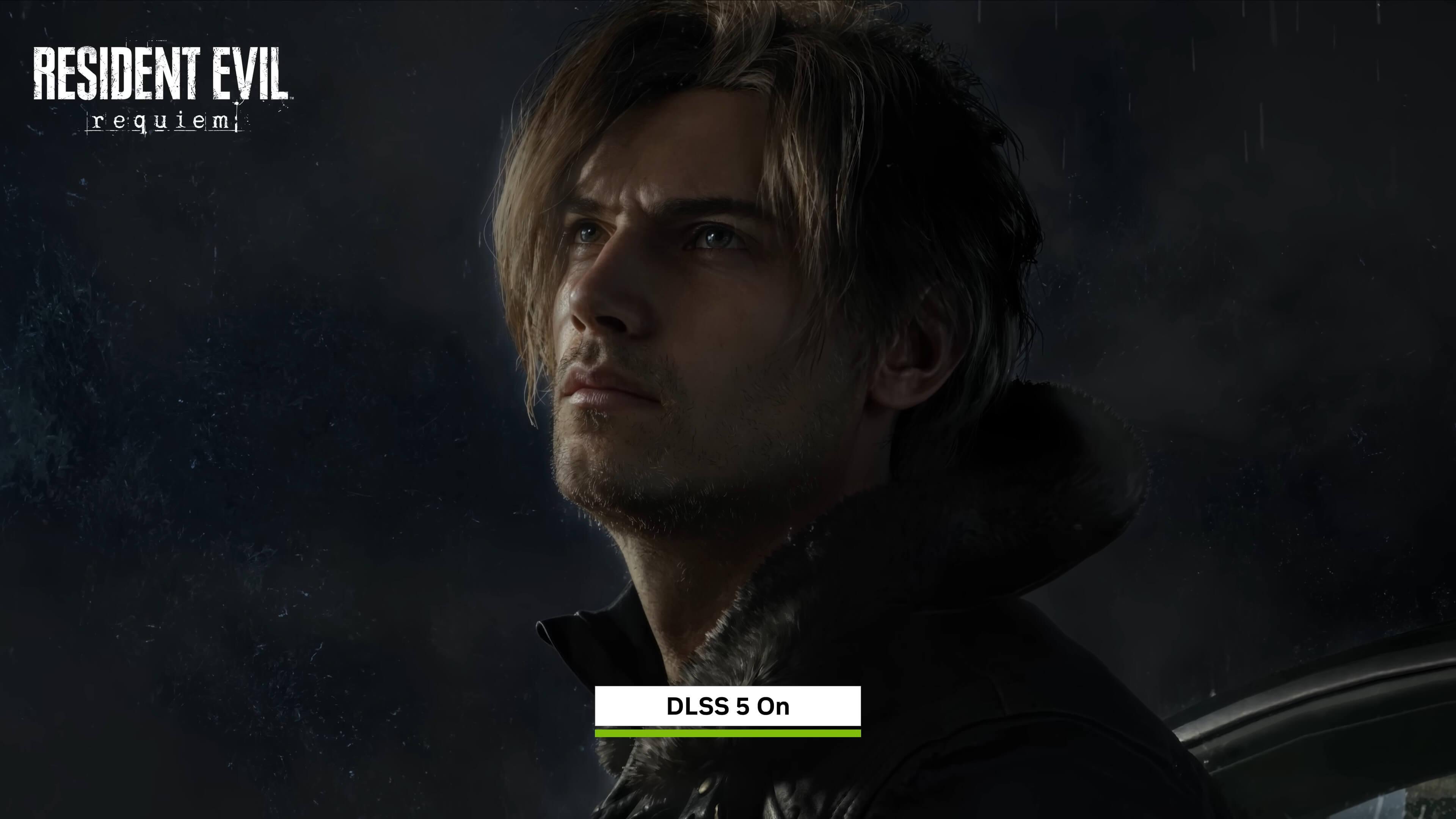

Para los que siguen el mundo gaming y renderizado, este fue el anuncio más espectacular. DLSS 5 introduce renderizado neuronal completo impulsado por IA generativa en tiempo real, lo que NVIDIA describe como el mayor avance en gráficos por computadora desde la introducción del renderizado en tiempo real.

Jensen dijo explícitamente que "el futuro es el renderizado neuronal", confirmando el cambio de dirección que NVIDIA había anticipado en CES 2026. En lugar de calcular píxeles matemáticamente como se ha hecho siempre, DLSS 5 usa IA generativa para construir frames completos fotorrealistas en hardware actual.

Estará disponible en otoño de 2026 con soporte inicial en Resident Evil: Requiem, Hogwarts Legacy, Starfield y Assassin's Creed Shadows.

IBM: Una integración de las librerías cuDL de NVIDIA en la plataforma watsonx.data de IBM para acelerar el procesamiento de bases de datos empresariales con una reducción de costos de cómputo de hasta el 83%.

Google Cloud: Nuevas máquinas virtuales G4 impulsadas por GPUs RTX Pro 6000 Server Edition y preparación conjunta para la infraestructura Vera Rubin NVL72.

AWS y OpenAI: NVIDIA ayudará a llevar a OpenAI a los servidores de AWS este mismo año para resolver sus cuellos de botella de capacidad de cómputo. Es una alianza que une a los tres actores más importantes del ecosistema de IA en un solo acuerdo.

Jensen anunció cuatro nuevos socios para la plataforma de robotaxis de NVIDIA: BYD, Hyundai, Nissan y Geely, más una alianza con Uber para integrar vehículos robotaxi-ready en su plataforma. "El ChatGPT moment de los autos autónomos ha llegado", dijo Jensen en el escenario.

En robótica, el momento más memorable fue cuando un robot de Olaf de Frozen, entrenado en una simulación desarrollada conjuntamente con Disney, caminó y conversó en el escenario con Jensen. Es la materialización más visual del concepto de gemelos digitales que NVIDIA lleva años desarrollando con Omniverse.

NVIDIA Space-1 Vera Rubin completa el panorama: centros de datos de IA en órbita terrestre, ofreciendo hasta 25 veces el cómputo de IA de una H100 para aplicaciones de datos orbitales.

La mayoría de estos anuncios tienen impacto indirecto pero real en el trabajo cotidiano de cualquier developer que usa modelos de IA.

En el corto plazo: Groq 3 LPU llegando en Q3 2026 significa que la velocidad de inferencia de la API de Groq, que muchos usamos para agentes locales, va a mejorar significativamente. Si usas Groq como proveedor para nanobot u OpenClaw, eso es una mejora directa sin cambiar nada.

En el mediano plazo: NemoClaw open source es relevante para cualquier empresa que quiera construir agentes internos sin depender de APIs externas. El stack de NVIDIA para agentes compite directamente con LangChain y el Vercel AI SDK, con la ventaja de estar optimizado para hardware NVIDIA.

En el largo plazo: El camino de chips de Rubin a Kyber a Feynman define cómo va a bajar el costo por token en los próximos tres años. Cada nueva generación ha reducido el costo de inferencia a la mitad o más. Lo que hoy cuesta $10 al mes en APIs de IA probablemente costará $2 o $3 en 2028.

Resolvemos las dudas específicas sobre este tema.