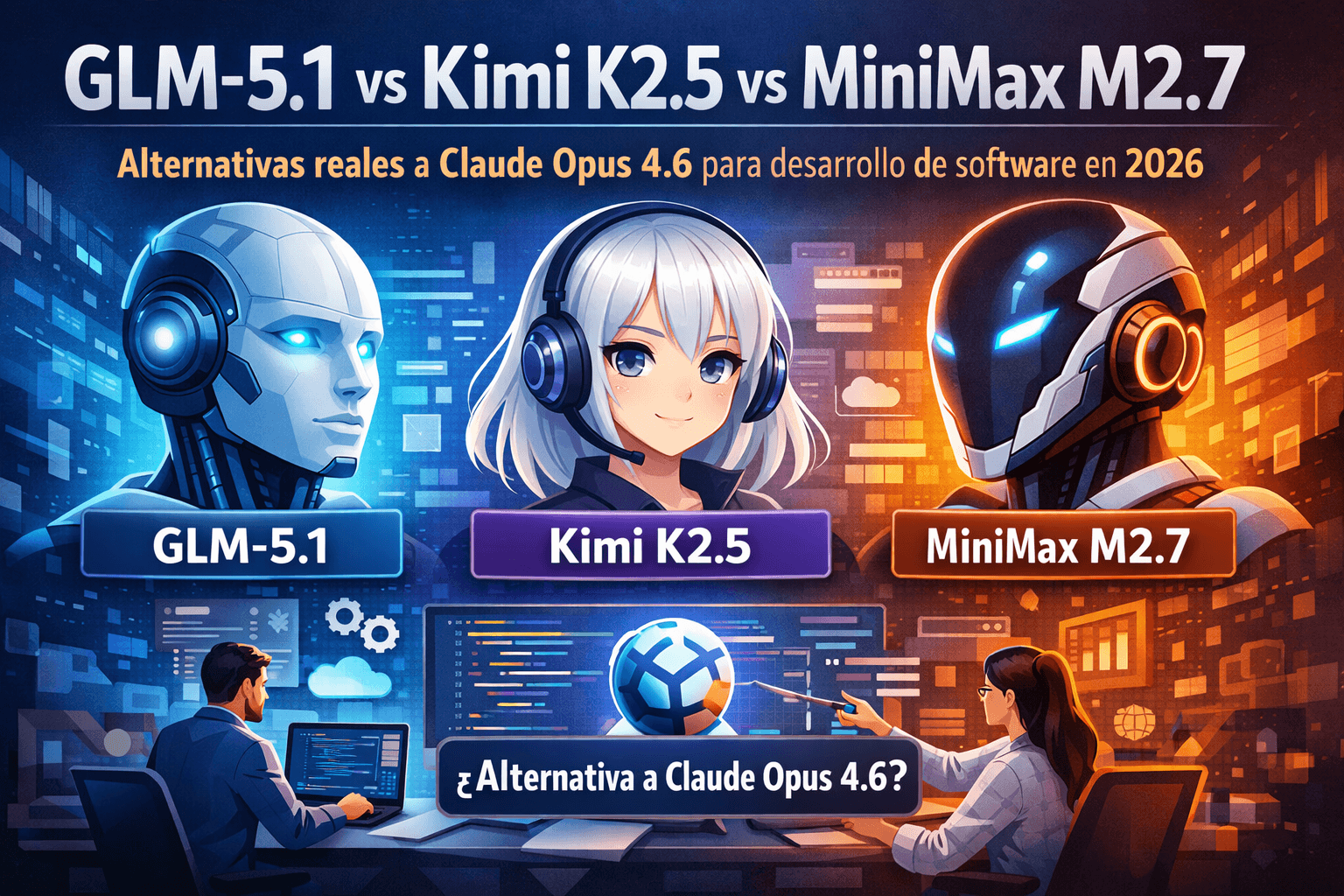

GLM-5.1 vs Kimi K2.5 vs MiniMax M2.7: alternativas reales a Claude Opus 4.6 para desarrollo de software en 2026

Comparativa técnica con benchmarks verificados: GLM-5.1, Kimi K2.5 y MiniMax M2.7 frente a Claude Opus 4.6. Precios reales en USD, casos de uso y cuándo vale la pena cambiar de modelo.

Jesús Blanco

Autor

GLM-5.1 vs Kimi K2.5 vs MiniMax M2.7: alternativas reales a Claude Opus 4.6 para desarrollo de software en 2026

Si usas Claude Opus 4.6 como motor principal de tus flujos de trabajo de desarrollo, probablemente ya conoces el problema: el modelo es extraordinariamente capaz, pero su costo escala rápido. A $15 por millón de tokens de salida, mantener múltiples agentes operando en paralelo sobre repositorios grandes puede consumir una fracción importante del presupuesto de infraestructura de cualquier proyecto.

La buena noticia es que en el primer trimestre de 2026 llegaron tres alternativas serias desde el ecosistema asiático. GLM-5.1 de Z.ai (antes Zhipu AI), Kimi K2.5 de Moonshot AI y MiniMax M2.7 no son simplemente "modelos más baratos": cada uno tiene fortalezas técnicas reales y casos de uso donde puede igualar o superar a Opus en tareas específicas.

Esta comparativa usa benchmarks de terceros y datos verificados para ayudarte a decidir cuándo, cómo y para qué tiene sentido diversificar tu stack de modelos.

El punto de partida: qué hace tan caro usar Claude Opus 4.6 en producción

Claude Opus 4.6 cuesta $5 por millón de tokens de entrada y $25 por millón de tokens de salida. Para conversaciones cortas eso es manejable, pero en flujos de agentes donde el modelo lee contexto de repositorios completos, genera planes, escribe código, itera sobre errores y produce informes, los tokens de salida se acumulan rápido.

La arquitectura multi-agente que muchos equipos presentan en meetups como el Claude Code Meetup de Monterrey es un buen ejemplo: un workflow de 6 pasos con instancias paralelas puede generar decenas de millones de tokens al mes en un equipo de desarrollo activo. Ahí es exactamente donde los modelos que veremos a continuación cambian la ecuación.

GLM-5.1: el modelo que Z.ai entrenó sin un solo chip de Nvidia

Z.ai lanzó GLM-5.1 el 27 de marzo de 2026 como una actualización de post-entrenamiento enfocada específicamente en coding. La arquitectura base no cambió respecto a GLM-5: sigue siendo un modelo Mixture-of-Experts de 744 mil millones de parámetros totales con 40 mil millones activos por inferencia, ventana de contexto de 200K tokens y atención dispersa de DeepSeek.

Lo que sí cambió fue el pipeline de reinforcement learning, que Z.ai redirigió hacia distribuciones de tareas de programación. El resultado es un salto del 28% en benchmarks de coding respecto a GLM-5: de 35.4 a 45.3 puntos en la evaluación que usa Claude Code como harness de prueba, frente a los 47.9 puntos de Opus 4.6.

Eso lo pone a 2.6 puntos de diferencia del modelo líder, o al 94.6% de su rendimiento en esa métrica.

Hay un dato de contexto importante: estos benchmarks son autoreportados por Z.ai y, al momento de publicar este artículo, no tienen verificación independiente de terceros. GLM-5.1 salió hace apenas tres días. La comunidad investigadora no ha tenido tiempo de replicar los resultados. Lo que sí está verificado externamente es el GLM-5 base: su 77.8% en SWE-bench Verified fue confirmado de forma independiente.

Otro dato relevante: Z.ai completó su IPO en la Bolsa de Hong Kong el 8 de enero de 2026, recaudando $558 millones de dólares. Y todo el entrenamiento del modelo se realizó en 100,000 chips Huawei Ascend 910B, sin ningún hardware de Nvidia, algo que tiene implicaciones tanto técnicas como geopolíticas.

Precios y acceso

El plan GLM Coding empieza en $3 dólares al mes como precio promocional, con un estándar de $10 al mes. La API de GLM-5 (el modelo base) ya está disponible a $1.00 por millón de tokens de entrada y $3.20 por millón de salida. El código de GLM-5.1 será open source bajo licencia MIT alrededor del 6 o 7 de abril.

Fortalezas reales y limitaciones

En pruebas independientes de BridgeBench, GLM-5.1 mide 44.3 tokens por segundo, lo que lo convierte en el modelo más lento de esta comparativa. Está optimizado para tareas largas y agénticas, no para autocompletado rápido en tiempo real.

Donde funciona mejor es en flujos de integración continua, scripts de terminal y configuraciones de infraestructura donde la velocidad de respuesta importa menos que la precisión del resultado.

Kimi K2.5: multimodal nativo y 100 agentes en paralelo

Moonshot AI lanzó Kimi K2.5 el 26 de enero de 2026. Es un modelo open-weight con arquitectura Mixture-of-Experts de 1 trillón de parámetros totales, 32 mil millones activos por inferencia, y una característica que no tienen los demás modelos de esta comparativa: fue entrenado de forma nativa con texto e imágenes mezclados desde el inicio, sobre 15 billones de tokens visuales y de texto.

Eso no es un añadido multimodal de última hora. Es una decisión de arquitectura que hace una diferencia práctica real en tareas de frontend donde el modelo puede leer un archivo de diseño y generar código que lo implementa sin necesidad de un paso intermedio de descripción textual.

La otra característica notable es el Agent Swarm: un modo de operación donde Kimi K2.5 puede orquestar hasta 100 subagentes simultáneos, coordinados mediante Parallel Agent Reinforcement Learning (PARL). Los benchmarks de Moonshot muestran reducciones de hasta 4.5x en tiempo de ejecución en tareas de búsqueda amplia comparado con agente único.

Precios y acceso

Kimi K2.5 es open-weight bajo licencia Apache 2.0, lo que significa que puedes descargarlo, fine-tunearlo y desplegarlo en tu propia infraestructura sin costo de licencia. El modelo tiene 32B parámetros, lo que lo hace accesible para inference en hardware con 24-48GB de VRAM.

El CLI oficial se llama Kimi Code y tiene una experiencia de uso similar a Claude Code. También está disponible vía API a través de la plataforma de Moonshot.

Fortalezas reales y limitaciones

La multimodalidad nativa es genuina, no post-hoc. En tareas de frontend donde el input es un mockup visual, Kimi K2.5 genera código que respeta el diseño original con menos alucinaciones visuales que otros modelos que procesan imágenes después del entrenamiento de texto.

El Agent Swarm es la característica más ambiciosa, pero también la menos probada en producción por la comunidad. Está en preview de investigación.

MiniMax M2.7: velocidad extrema, precio mínimo y contexto de 1M tokens

MiniMax lanzó M2.7 el 17 de febrero de 2026, posicionándolo como el modelo más rápido de la comparativa. El benchmark de BridgeBench lo mide en 286 tokens por segundo, casi 6.5 veces más rápido que GLM-5.1 y muy por encima de la velocidad de Opus 4.6 en tareas equivalentes.

La otra ventaja es el precio. MiniMax M2.7 cuesta $0.0002 por 1,000 tokens de salida, lo que lo pone 125 veces más barato que Opus 4.6 en la misma métrica. Es, con diferencia, el modelo con mejor relación costo-rendimiento de esta comparativa.

El contexto de 1 millón de tokens es la tercera característica notable. Los otros modelos de esta comparativa tienen ventanas de 200K (GLM-5.1) y 128K (Kimi K2.5). Un millón de tokens es útil para análisis de repositorios muy grandes donde la mayoría de los modelos tendría que hacer chunking del código, con el riesgo de perder contexto de dependencias cruzadas.

Precios y acceso

MiniMax M2.7 es propietario. No hay open weights, pero está disponible a través de OpenRouter y de la API directa de MiniMax. El modelo tiene un tier gratuito limitado y luego precios por volumen que escala de forma agresiva conforme aumenta el uso.

Fortalezas reales y limitaciones

La velocidad lo hace especialmente interesante para autocompletado y sugerencias en tiempo real dentro de editores. No estás limitado a conversaciones cortas; la velocidad de 286 tokens por segundo significa que una respuesta de 500 tokens llega en menos de 2 segundos.

El precio hace que sea viable para flujos de alto volumen: pruebas automatizadas, generación de datos de prueba, refactorizaciones batch, migraciones donde se procesan muchos archivos en secuencia.

La limitación principal es que es propietario. Si tu política de infraestructura requiere self-hosting, MiniMax M2.7 no es una opción viable.

Tabla comparativa de especificaciones

| Característica | GLM-5.1 | Kimi K2.5 | MiniMax M2.7 | Claude Opus 4.6 |

|---|---|---|---|---|

| Parámetros totales | 744B MoE | 1T MoE | Propietario | ~200B |

| Parámetros activos | 40B | 32B | Propietario | ~40B |

| Ventana de contexto | 200K | 128K | 1M | 200K |

| Velocidad (tokens/s) | 44.3 | ~100 | 286 | ~50 |

| Costo salida ($/1M tokens) | $3.20 | $0 (self-host) | $0.20 | $25.00 |

| Open source | Parcial | Sí (Apache 2.0) | No | No |

| SWE-bench Verified | 77.8% (base) | 79.2% | 86.4% | 47.9% (eval. alt.) |

Cuándo usar cada modelo en un flujo real de desarrollo

La estrategia correcta no es reemplazar Claude Opus 4.6, sino enrutar las tareas al modelo más eficiente según su naturaleza.

Para las tareas del día a día en terminal, configuraciones de Docker, scripts de bash y flujos de CI/CD, GLM-5.1 ofrece rendimiento cercano a Opus a una fracción del costo, con el beneficio adicional de que pronto será completamente open source y deployable en infraestructura propia.

Para frontend, maquetación desde diseños visuales y flujos que requieren múltiples agentes trabajando en paralelo, Kimi K2.5 es la opción más interesante. Su precio por token es 10 veces menor que Opus y su capacidad multimodal nativa es real y diferenciada.

Para refactorizaciones profundas, migraciones de bases de datos, auditorías de código heredado y debugging en sistemas de producción donde la precisión importa más que la velocidad, MiniMax M2.7 combina rendimiento de primera línea con el precio más bajo de la comparativa.

Y Claude Opus 4.6 sigue siendo la opción correcta para decisiones de arquitectura general, orquestación de workflows complejos que requieren el millón de tokens de contexto, y cualquier tarea donde la ventana de contexto extendida sea el factor determinante.

La diversificación del stack de modelos no es una concesión de calidad. Es ingeniería de costos.

¿Necesitas ayuda para elegir el stack de modelos para tu proyecto?

Cada equipo tiene un mix diferente de necesidades: volumen de código, presupuesto disponible, requisitos de privacidad, capacidad de infraestructura. En Fencode ayudamos a empresas a diseñar arquitecturas de AI coding que maximicen rendimiento sin escalar costos innecesariamente.

Tags:

Preguntas Frecuentes del Artículo

Resolvemos las dudas específicas sobre este tema.